Verlässlichkeit von Studien: Wann wir Zahlen vertrauen

Wissenschaftliche Ergebnisse sind nie exakt. Doch wie transparent sollen Forscher*innen in ihren Studien mit Unsicherheiten umgehen?

Die Öffentlichkeit kommt mit Unsicherheit klar. Wahrscheinlich Foto: Alexabdra Beganskaya/Pond5/imago

Es ist nicht leicht, der Öffentlichkeit Wissenschaft zu erklären. In Studien steht oft, dass die Ergebnisse nicht exakt so stimmen, sondern mit einer gewissen Wahrscheinlichkeit in einem Bereich liegen.

Bei so und so viel Kohlenstoff in der Atmosphäre wird sich die Erde beispielsweise nicht genau um zwei Grad erwärmen, sondern in einem Bereich um zwei Grad. In der Fachzeitschrift Royal Society Open Science ist nun eine Studie erschienen, die untersucht, wie man solche Unsicherheiten am besten kommuniziert.

Die Studie

Die Forscher*innen führten in den ersten Wochen der Coronapandemie zwei Experimente durch. Beim ersten Experiment bekamen die Teilnehmer*innen einen kurzen Text darüber zu lesen, wie wahrscheinlich es derzeit sei, als 70- bis 80-Jährige*r mit einer Corona-Infektion ins Krankenhaus zu kommen. Es gab drei Versionen dieser Information, die Teilnehmer*innen bekamen jeweils eine zu lesen.

Die erste: Die Wahrscheinlichkeit liege bei 17 Prozent. Die zweite: Die Wahrscheinlichkeit liege zwischen 10 und 34 Prozent. Die dritte: Die Wahrscheinlichkeit liege bei 17 Prozent, könne aber auch höher oder niedriger sein.

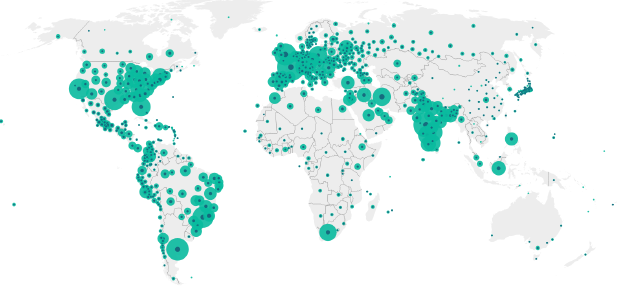

Die Teilnehmer*innen kamen aus aller Welt. Ein zweites, analog aufgebautes Experiment wurde im Anschluss mit Proband*innen aus Großbritannien durchgeführt.

Nach der Lektüre des Textes sollten die Teilnehmer*innen angeben, wie sehr sie den Zahlen und der Quelle der Information trauen. Die Ergebnisse des ersten Experiments: Die Proband*innen nahmen die Unsicherheit nur dann wahr, wenn sie erwähnt wurde. Sie vertrauten der Prozentangabe weniger, wenn die Unsicherheit als Zahl angegeben wurde, aber noch weit weniger, wenn sie nur ungefähr angegeben wurde.

Dieser Text stammt aus der wochentaz. Unserer Wochenzeitung von links! In der wochentaz geht es jede Woche um die Welt, wie sie ist – und wie sie sein könnte. Eine linke Wochenzeitung mit Stimme, Haltung und dem besonderen taz-Blick auf die Welt. Jeden Samstag neu am Kiosk und natürlich im Abo.

Der Quelle der Information vertrauten die Teilnehmer*innen ähnlich stark, wenn die Unsicherheit gar nicht oder als Zahl angegeben wurde, während das Vertrauen sank, wenn sie als „höher oder niedriger“ formuliert war.

Was bringt’s?

Unter anderem die Erkenntnis, dass es große regionale Unterschiede gibt. Die Teilnehmer*innen aus Großbritannien fanden die Informationsquelle nicht weniger vertrauenswürdig, wenn die Unsicherheit mit „höher oder niedriger“ angegeben wurde. Schwed*innen vertrauen einer Zahl weit mehr, wenn die Unsicherheit beziffert angegeben ist, Koreaner*innen vertrauen ihr dann allerdings weit weniger.

Und Deutsche finden es ein kleines bisschen vertrauenswürdiger, die „höher oder niedriger“-Formulierung zu lesen. Die empfundene Vertrauenswürdigkeit geht also stark auseinander.

Woran genau das liegt, muss noch erforscht werden. Die Autor*innen schreiben, dass auch andere Studien zu dem Ergebnis kommen, dass Vertrauen vom Kontext abhängt. Aber wer wissenschaftliche Ergebnisse vermitteln will, kann sich schon mal merken: Die Öffentlichkeit kommt mit Unsicherheit klar. Wahrscheinlich.

Leser*innenkommentare

Martin Rees

"Die Autor*innen schreiben, dass auch andere Studien zu dem Ergebnis kommen, dass Vertrauen vom Kontext abhängt."

Vielleicht "fragen Sie Ihren Arzt oder Apotheker" lieber bei hochkomplexen Statistiken doch nicht zu genau.

"Multivariable Analysen können mit der Cox-Regression durchgeführt werden. Anhand der Hazard Ratios mit Konfidenzintervallen kann man die Ergebnisse interpretieren. Leider werden die Voraussetzungen für die Cox-Regression nicht immer beachtet (zum Beispiel „proportional hazards“, zeitabhängige Variablen), deshalb sind viele publizierte Analysen oft fehlerbehaftet. Es ist wichtig, dass der Leser einer wissenschaftlichen Publikation diese Fallstricke kennt und beurteilen kann, ob die gewählte Auswertestrategie korrekt ist."

Der adressierte "Leser" ist fachspezifisch vorgebildet, dennoch oft ohne erläuternden Kontext im eigenen Vokabular machtlos, die Fehlerquellen ggf. als "Falltüren" zu erkennen. Also braucht es klare Leitplanken, nicht zuletzt bei Therapierelevanz von Entscheidungen oder Bewilligung von Geldern für Forschung.

Quelle Zitat:

www.aerzteblatt.de...rlebenszeitanalyse

Zangler

Das ist doch ein Kategorienfehler! Die Mathematik hinter den Zahlen stimmt, Rechenfehler werden eher über kurz als über lang aufgedeckt. Ich vertraue größtenteils auch dem wissenschaftlichen Prozess, gefälschte Daten werden ebenfalls aufgedeckt.

Politische Entscheidungen sollten aber nicht auf der Basis einzelner Studien getroffen werden, sondern auf Metastudien beruhen, denen eine Definition der politischen Ziele und Rahmenbedingungen zugrundegelegt wird.

„Vertrauen“ kann man, dass der wissenschaftliche Prozess mit Review, Reproduktionsstudien etc. funktioniert, „Misstrauen“ darf man haben, dass die politischen Entscheidungen, die auf wissenschaftlicher Basis getroffen zu sein behaupten, dies auch wirklich sind. Letztlich sind Politiker:innen von Ideologien und Interessen geleitet, und nutzen Wissenschaft aus. Das hat aber nichts mit statistischen Wahrscheinlichkeiten zu tun.

Rudolf Fissner

"Die Autor*innen schreiben, dass auch andere Studien zu dem Ergebnis kommen, dass Vertrauen vom Kontext abhängt. "

Inwiefern wurden die Autoren selber aus dem Kontext heraus gerechnet. Ergebnisse von Umfragen hängen stark auch vom Fragenden ab. Und deren Reputation kann von Land zu Land stark differieren.

wxyz

Wenn es um die Frage geht, wie sehr "wir" solchen Zahlen vertrauen, dann sollte zumindest klargestellt werden (was nahezu nie geschieht), daß auch solche Umfrageergebnisse Zahlen sind, die fast immer nur wiederspiegeln, wie sehr die Befragten dem vertrauen, was sie aus irgend einer Zeitung oder Fernsehsendung aufgeschnappt haben, das Behauptete aber nie selbst nachgeprüft haben, weil sie es gar nicht konnten.

Es geht da also gar nicht um Wissenschaftsvertrauen, sondern lediglich um das Vertrauen in Medienberichterstattungen bzw. um mehr oder weniger ausgeprägte Gläubigkeit in das, was andere behauptet haben.

Selbst in Studentenkreisen geht es oftmals nicht um das Vertrauen in die Richtigkeit des aktuell Gelehrten, sondern mehr um den Glauben, welche "richtigen" Antworten zu einer besseren Benotung führen.

Ich mißtraue deshalb solche Studien und Berichte darüber immer dann maximal, wenn sie zusätzlich mit Wissenschaftlichkeit vortäuschendem Zahlenmaterial gespickt sind, obwohl es sich bei genauerer Betrachtung lediglich um Glaubensfragen handelt.

Troll Eulenspiegel

Ich vertraue wissenschaftliche Fakten, wenn die Signifikanz bei mindestens σ = 5 ist.

Das bedeutet, dass ein Ereignis mindestens 3,5 Millionen mal per Zufall eintreffen muss. Also 3,5 Millionen Hitzewellen über Deutschland hintereinander.

Dass stattdessen der menschengemachte Klimawandel zum Massensterben beiträgt, statt 3,5 Millionen Zufällen sollte jedem bewusst sein. Aber nein, lieber vertraut man blind irgendwelchen Verschwörungen wie Wetterwaffen. Ist auch viel einfacher zu verstehen, als σ = 5.

Chris Demian

@Troll Eulenspiegel Sigma = 5 ist eine Wahrscheinlichkeit von 1 : 3,3(...) Sorry für die Pingeligkeit, aber ich hatte das Bedürfnis etwas Konkretes mitzuteilen, nach soviel Vagheiten. Es fragt sich nur, wie die Forschenden, die Ergebnisse formuliert haben. Ich tippe mal: Wahrscheinlichkeit, dass unsere Ergebnisse stimmen liegt bei 94 % — mehr oder weniger... Und dass sie als vertrauenswürdig gelten werden bei viel weniger.

Chris Demian

@Chris Demian 1:3.3(...) Millionen versteht sich...